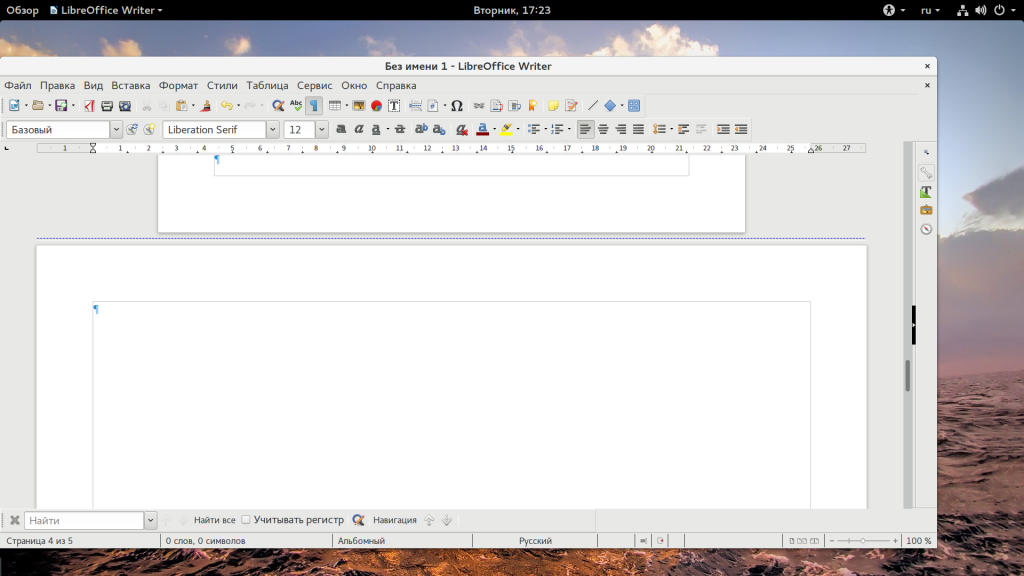

По умолчанию в редакторе LibreOffice страница выглядит точно так же, как и обычный лист бумаги А4 и имеет портретную ориентацию. Это необходимо потому что для большинства офисных документов, рефератов, курсовых и дипломных работ по умолчанию принята такая ориентация.

По умолчанию в редакторе LibreOffice страница выглядит точно так же, как и обычный лист бумаги А4 и имеет портретную ориентацию. Это необходимо потому что для большинства офисных документов, рефератов, курсовых и дипломных работ по умолчанию принята такая ориентация.

Мы живём в опасное время: едва ли не каждый день обнаруживаются новые уязвимости, на их основе создают эксплойты, под ударом может оказаться и обычный домашний компьютер на Linux, и сервер, от которого зависит огромная организация.

Возможно, вы уделяете внимание безопасности и периодически обновляете систему, но обычно этого недостаточно. Поэтому сегодня мы поделимся двенадцатью советами по повышению безопасности Linux-систем

Американский журнал Popular Mechanics, рассказывая о новом эскадренном миноносце с управляемым ракетным оружием USS Zumwalt, сообщил, что его программное обеспечение работает под операционной системой GNU/Linux.

Американский журнал Popular Mechanics, рассказывая о новом эскадренном миноносце с управляемым ракетным оружием USS Zumwalt, сообщил, что его программное обеспечение работает под операционной системой GNU/Linux.

Близкое знакомство с возможностями терминала — один из признаков человека, который хорошо разбирается в Linux. Хотя некоторые вещи запомнить сложно, есть довольно-таки простые, но эффективные приёмы, которые способны повысить качество и скорость работы в терминале. Пожалуй, каждый пользователь Linux рано или поздно обзаводится собственным списком ценных мелочей. Надеемся, некоторых из тех десяти приёмов работы в командной строке Linux, которыми мы хотим с вами поделиться, попадут в ваш личный список полезных команд.

Что вы делаете со старыми компьютерами? У вас есть компьютер, который когда-то имел очень мощную аппаратную конфигурацию, но теперь, он считается устаревшим?

Почему бы не возродить свой старый компьютер с помощью Linux? Мы перечислим семь дружественных легковесных дистрибутивов Linux, которые вы сможете использовать на своем старом компьютере.

Это не рейтинг, а который лучший из них, решайте сами.

Именно от операционной системы зависит, как будет работать ваш ноутбук, и какое рабочее окружение вы выберите. В этой статье, я постараюсь на своем опыте, и отзывах других пользователей, выбрать лучшие дистрибутивы Linux для ноутбуков.

Возможно, не все системы будут перечислены, и как говорится всем не угодишь. Но если вы знаете, и пользуетесь какой-то интересной системой, то можете поделиться ею в комментариях.

Хотите измерить пиковую производительность своего графического ускорителя? Задумываетесь о корректности работы своего графического ускорителя под максимальной нагрузкой?

Вы можете без каких-либо проблем развеять все свои сомнения благодаря существованию нескольких инструментов для тестирования производительности графических ускорителей; мы будем рассматривать три отличных инструмента, а именно:

Раньше играть на Linux приходилось крайне редко, но после того, как Steam появился на Linux, игровое Linux сообщество воспрянуло духом.

Перед тем как перейти к играм, давайте кое-что проясним. 2016 год - это не так и давно, и игры перечисленные здесь - довольно яркие и будут интересны даже сейчас. Некоторые из нижеописанных игр могли выйти раньше, но на других платформах.

Каждый смартфон состоит из множества сложных компонентов и вы не всегда будете думать о них перед выбором модели аппарата. Но, тем не менее, важно знать какие аппаратные средства помогают вашему смартфону функционировать.

В наше неспокойное время пользователей всё больше беспокоит вопрос безопасности своей системы. Очень многие люди в первую очередь переходят на открытое и свободное ПО. Для дополнительной защиты многие применяют различные средства, от запуска браузеров и прочих потенциально уязвимых программ в виртуальных машинах и контейнерах, до создания изолированного окружения и написания политик безопасности. Несомненно, каждый способ хорош по своему, у каждого из них есть достоинства и недостатки. Сегодня я расскажу об одной маленькой, но крайне интересной утилите Firejail.

В наше неспокойное время пользователей всё больше беспокоит вопрос безопасности своей системы. Очень многие люди в первую очередь переходят на открытое и свободное ПО. Для дополнительной защиты многие применяют различные средства, от запуска браузеров и прочих потенциально уязвимых программ в виртуальных машинах и контейнерах, до создания изолированного окружения и написания политик безопасности. Несомненно, каждый способ хорош по своему, у каждого из них есть достоинства и недостатки. Сегодня я расскажу об одной маленькой, но крайне интересной утилите Firejail.

Страница 9 из 96